Cina. Big data e polizia predittiva al servizio della repressione

![]()

Big data, crediti sociali e polizia predittiva sono utilizzati per identificare gli uiguri da internare nei centri di rieducazione della regione cinese dello Xinjiang. Sono proprio le tecnologie di ultima generazione a essere finite al centro di un rapporto shock diffuso dalla Human Rights Watch (Hrw), basato su un leak ottenuto nel 2018, che fa luce sugli strumenti utilizzati da Pechino per garantire l’efficacia del sistema detentivo nella regione autonoma cinese.

IL GRUPPO PER LA TUTELA dei diritti umani ha trascorso gli ultimi due anni ad analizzare un database contenente i nomi di 2000 uiguri detenuti tra il 2016 e il 2018 nella prefettura di Aksu. La Hrw, con i documenti ottenuti da una fonte anonima, mantiene accesi i riflettori sulla campagna di repressione e detenzione che colpisce le minoranze musulmane in Cina.

Nel rapporto, la Hrw evidenzia la funzionalità della Piattaforma integrata per le operazioni congiunte (Ijop), che gioca un ruolo chiave nel tenere traccia delle reti personali degli individui, della loro attività online e della vita quotidiana. L’analisi del leak, inoltre, suggerisce che la maggioranza delle persone è finita nei centri pur avendo comportamenti leciti e non violenti.

È facile finire nel mirino delle autorità. Numerose sono le trasgressioni che portano all’arresto arbitrario e senza un processo giudiziario: studiare il Corano, avere rapporti con parenti residenti in «Paesi sensibili» (come Turchia, Afghanistan, Arabia Saudita e Kyrgyzstan), osservare i precetti della religione musulmana, oppure essere nati dopo gli anni ‘80; anche non pagare l’affitto o praticare la poligamia rientrano nella lista di comportamenti di persone «generalmente inaffidabili». Ma a determinare la detenzione è anche l’utilizzo di alcune app o la condivisione sul web di contenuti terroristici.

LA LISTA DEI DETENUTI nella prefettura di Aksu, che segue la recente pubblicazione di un altro database con i nomi dei prigionieri nella contea di Karakax – sempre nello Xinjiang – presenta una condizione allargata al contesto nazionale.

La Hrw ritiene che il sistema Ijop è utilizzato anche al di fuori della regione. La China Electronics Technology Group Corporation, la società che si è occupata della progettazione e distribuzione dell’Ijop nello Xinjiang, lo scorso gennaio ha venduto la Ijop alle autorità di Yinchuan, capitale della provincia di Ningxia, dove c’è un’alta concentrazione dell’etnia musulmana Hui. Valore di vendita: 43 milioni di dollari.

I giganti tecnologici cinesi traggono profitto dalla repressione esercitata dal Partito comunista cinese sulle minoranze etniche di fede musulmana.

Huawei, il colosso con sede a Shenzhen, nel 2018 ha testato un software di riconoscimento facciale che consente di inviare una notifica o un segnale di allarme alle autorità cinesi quando i sistemi di videosorveglianza riconoscono i tratti del viso di uno uiguro.

A RIVELARLO È UN DOCUMENTO interno firmato dai rappresentanti di Huawei, ottenuto dalla società statunitense di videosorveglianza Ipvm e condiviso con il Washington Post. In base al rapporto, Huawei ha lavorato con l’azienda cinese Megvii per progettare un sistema di telecamere a intelligenza artificiale, capace di scansionare i volti della persone, stimando l’età, il sesso e l’etnia.

Un meccanismo in grado di funzionare con precisione anche nelle trafficate strade cinesi.

Il documento, attualmente rimosso dal sito web di Huawei, potrebbe alimentare le polemiche sul colosso tecnologico, ritenuto dall’amministrazione Trump un’arma di spionaggio nelle mani del Pcc. In base alle rivelazioni pubblicate dalla testata Usa, Huawei e Megvii hanno fornito congiuntamente una soluzione di riconoscimento facciale basata sulla soluzione cloud video di Huawei; nel dettaglio, Huawei ha fornito i server, lo spazio di archiviazione, le apparecchiature di rete, la sua piattaforma cloud FusionSphere, oltre a fotocamere e videocamere, mentre Megvii ha condiviso il software del sistema di riconoscimento facciale dinamico. Tuttavia, i due giganti tecnologici negano che il sistema di telecamere sia stato progettato per rafforzare il controllo sociale su base etnica.

* Fonte: Serena Console, il manifesto

Related Articles

Ttip, il trattato trita-tutto

![]()

Stop Ttip. Renzi, insieme al fedelissimo ministro all’agricoltura Maurizio Martina, nonostante i danni che l’Italia ne ricaverebbe, sembrano essere ormai gli «ultimi giapponesi» rimasti dentro la trincea degli interessi corporativi

Family Day 2.0, la persistenza dell’estremismo clericale

![]()

Omofobia a piazza San Giovanni. Hanno chiamato tutte le proto-religioni per negare i diritti delle persone gay

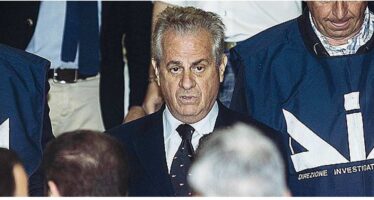

Migliaia di fascicoli su politici e favori L’archivio di Scajola sotto sequestro

![]()

Sequestrati documenti riservati, veri e propri dossier che l’ex ministro dell’Interno Claudio Scajola custodiva nei propri studi di Roma e Imperia